Futuros de la inteligencia artificial12

Vol. 21, núm. 1 enero-febrero 2020

Futuros de la inteligencia artificial

Guadalupe Vadillo CitaResumen

Dado el desarrollo acelerado de la inteligencia artificial y su impacto en una inmensa gama de actividades y disciplinas, existe un interés por imaginar sus posibles escenarios en el futuro. Se presenta un compendio de opiniones de cuatro expertos mexicanos que se complementa con una síntesis de algunos estudios previos. En especial se abordan la singularidad, las oportunidades que ofrece y los riesgos que puede suponer.

Palabras clave: Inteligencia artificial, futuro, estudios prospectivos.Futures of artificial intelligence

Abstract

Due to the fast evolution of artificial intelligence and its impact on a variety of activities and disciplines, there is interest in imagining its possible future scenarios. We present a summary of contributions from four Mexican researchers, complemented with some previous studies and insights on the subject. They focus on the singularity, the opportunities artificial intelligence entails as well as the risks that it may involve.

Keywords: artificial intelligence, future, future studies.El interés por el futuro

Viajemos hacia atrás en el tiempo, 77 años, cuando Asimov publicó un cuento titulado “Runaround”, donde introducía las tres leyes de la robótica1 (Kaminka, Sponkoini-Stern, Amir, Agmon y Bachelet, 2017). Unos años más tarde, en 1950, Turing publicó el artículo que pasaría a la historia: “Computing machinery and intelligence” en el que se preguntaba si las máquinas podían pensar (Castelfranchi, 2013). Finalmente, en 1956, Minsky y McCarthy acuñaron el término de inteligencia artificial durante el Dartmouth Summer Research Project on Artificial Intelligence (Howard, 2019). Minsky contaría al New York Times que después de leer “Runaround”, en marzo de 1942, nunca dejó de pensar cómo las mentes pueden trabajar y que algún día se construirían robots que piensen.2

Nuestro oráculo especial

Para responder a esta pregunta convocamos a cuatro expertos en el tema que accedieron a constituirse en un oráculo para este artículo. Los presentamos en la imagen 1.

Imagen 1. Expertos que colaboraron en este estudio (fotos aportadas por los especialistas).

¿Qué indican los estudios de futuro sobre la IA?

Cuando exploramos el campo, tenemos un abanico que va desde la cautela extrema y predicciones sobre la imposibilidad de que la ia compita con la inteligencia humana, hasta una seguridad total acerca de su potencial espectacular. Por un lado, Steven Livingston, de la George Washington University, y Mathias Risse, de Harvard, (2019) destacan que no existe aún una “superinteligencia”, o inteligencia artificial general, es decir, un algoritmo o una serie de algoritmos que al menos tengan igual capacidad que los humanos en diferentes dominios. Por otra parte, Anthony Miller (2019), desde Gran Bretaña, considera que la humanidad debe decidir subirse a la emocionante ola de cambios que trae consigo la ia o resistirse al cambio inevitable que tendrá el mundo como lo conocemos. Concluye que, si la humanidad no se decide por la colaboración, seremos ciudadanos de segundo nivel en nuestro propio mundo. Demos una mirada a lo que se ha logrado hasta ahora, para poder medir los alcances de las predicciones. Livingston y Risse (2019), señalan que los intentos actuales de expandir la adaptabilidad de algoritmos a distintos dominios de problemas, están representados por DeepMind de Google y por Google Brain. Del primero se desprende el programa de cómputo AlphaGo, quizá la evidencia más clara del desarrollo en este sentido; este programa se desarrolló para jugar ese juego de mesa. En su entrenamiento inicial se usaron treinta millones de jugadas de 160 mil partidas de excelentes jugadores de ajedrez como input. Su “aprendizaje” posterior fue por reforzamiento, jugando contra versiones previas de sí mismo durante miles de veces, con lo que hay mejoras en cada iteración. La primera iteración se llamó AlphaGo Zero y en las primeras tres horas, logró la competencia de un humano amateur, en 19 horas las de uno avanzado y en tres días venció a la versión AlphaGo que había vencido en 2016 al mejor jugador profesional de Go del mundo. Los investigadores orientan su escrito a ia y derechos humanos, y señalan que ya existen incidencias en este campo en la actualidad. Por ejemplo, se logró la captura de un jefe militar libio a partir de imágenes de ejecuciones que él ordenó o realizó, y que aportaban indicios de lugares geográficos en tiempos específicos, que después se contrastaron con imágenes satelitales. Asimismo, Livingston y Risse señalan que en antropología forense es posible contar con el apoyo de ia para secuenciar adn en forma paralela y masiva, con objeto de establecer la identidad de las víctimas con base en unos cuantos restos óseos. Si bien ha habido aportaciones importantes de la ia, tenemos que tomar en consideración que puede haber errores en los procesos. Un ejemplo es el caso de una ia que, en lugar de aprender a distinguir tanques de guerra, aprendió a distinguir los paisajes donde se encuentran (Yudkowsky, 2008 en Yampolskiy, 2019).Expertos y no expertos en la creación de futuros de la IA

Carlos Gershenson, uno de los especialistas que consultamos, considera que la relación entre los humanos y la ia, con el tiempo, se volverá más codependiente y que la tendencia es hacia una simbiosis, aunque los cambios en la siguiente década no serán notorios. Asimismo, señala que la ia estará más embebida en nuestra tecnología. Óscar Herrera piensa que la ia dentro de unos años pasará desapercibida, como sucede con la luz o el Internet. Imagina que la ia estará inmersa en cada dispositivo, tecnología, medio de difusión, modelo educativo, ideológico y formativo, además de ser parte de los modelos de negocio. Omar Montaño considera que los asistentes personales que tendremos serán más eficientes que los humanos y que la ia tendrá un impacto importante en medicina, ciberseguridad y desarrollo de software libre de errores, entre otras áreas. Por su parte, Francisco Cervantes enfatiza el uso de aplicaciones basadas en ia para actividades como el diagnóstico médico y de uso cotidiano, como los carros autónomos, y los audífonos y lentes enriquecidos con realidad aumentada o virtual. ¿Y qué dicen los no expertos? La Fundación Mozilla (2019) publicó en noviembre de 2019 los hallazgos de la encuesta a 66,800 personas de todo el mundo sobre este tema. Los resultados principales fueron:- 86.8% contestó que no sabía mucho sobre ia o tenía algunas nociones,

- 80% de los jóvenes de 19 a 24 años considera tener más conocimientos que los de 24 a 44 años (75%) o los de 45 a 75 (59%);

- en cuanto a los sentimientos que la ia genera, el 32% de la gente señala preocupación, el 30% curiosidad y el 27% ilusión; y

- la mayor parte considera que la ia debe ser mucho más inteligente que los seres humanos y sólo 10% que es mejor que sea tonta.

Singularidad

Vernor Vinge, un profesor de matemáticas y escritor de ciencia ficción, quien popularizó el término singularidad que se refiere a un punto hipotético en el futuro, cuando la inteligencia artificial supera a la del hombre. Se trata del posible momento en el que el desarrollo tecnológico con ciclos de auto-mejoramiento lleva a que el agente inteligente no humano sobrepase a la inteligencia humana. Vinge señaló en su ensayo de 1993 “The comming technological singularity” que se sorprendería si sucediera antes de 2005 o después de 2030 (en Zovko, 2018).

Imagen 2. Vernon Vinge en 2006 (Raul654, 2006).

Hay poco acuerdo en cuanto a si ese momento hipotético llegará o no. Los expertos mexicanos que consultamos son un ejemplo de estas diferencias: Carlos Gershenson, indicó que nunca llegará, que se trata de un concepto equivocado y que una tendencia exponencial no lleva a una singularidad, tendría que tratarse de una función hiperbólica. Además, piensa, que las tendencias tienden a cambiar: la Ley de Moore lleva años desacelerándose y aunque nuestro poder de cómputo se ha incrementado exponencialmente durante décadas, nuestra habilidad para desarrollar software lo ha hecho de manera sublineal. Por su parte, Omar Montaño indicó que sí sucederá dentro de 20 o 30 años, mientras que Óscar Herrera señaló que no se notará y Francisco Cervantes que ya llegó, en tanto que la adaptabilidad humana es menor al crecimiento tecnológico, lo que nos obliga a aprender más rápidamente y crecer de forma inteligente. Para hacer evidente la disparidad de posiciones, basta con leer el número que editaron Adriana Braga, de la Pontificia Universidad Católica de Río de Janeiro y Robert Logan, de la Universidad de Toronto (2019). En este trabajo llevaron a cabo una convocatoria de artículos para la revista Information y se presentaron textos a favor y en contra de la idea de la singularidad. Los críticos señalan que la inteligencia humana no solo incluye operaciones lógicas y computación, sino también deseos, juicios, experiencias, curiosidad, imaginación y humor, entre otros elementos. Concluyen que lo mejor es la colaboración entre humanos e ia, que ésta por sí sola nunca reemplazará la inteligencia humana y que no se puede confiar en la ia para obtener la respuesta correcta. Miller (2019) está seguro de que la singularidad llegará y se sobrepasará. Debido a ello, opina que los humanos y la ia se esforzarán por llegar a la inteligencia artificial general, lo que significa una evolución conjunta de humanos e ia. Considera que son tres los factores que se entrelazarán para esa transformación: Big data, la computación cuántica y la tecnología de interfaz cerebro-computador, que pueden llevar a la ia a una velocidad de evolución casi inimaginable. Veamos uno por uno lo que estos factores suponen.- Big data implica:

- grandes cantidades de datos generados por fuentes diversas, como las comunicaciones, la manufactura o las áreas de salud, pero también la interacción humano-ia y el internet de las cosas,

- una amplia variedad en que los datos pueden usarse para analizar un evento o un predicamento, y

- una velocidad creciente de los datos, ya que con el desarrollo de la tecnología crece la cantidad de datos.

- La computación cuántica: tiene la meta de lograr millones de veces más poder que el que ofrecen las computadoras clásicas. En lugar de trabajar con ceros y unos, la computación cuántica usa cúbits, que, a través de la llamada superposición, en un mismo momento pueden ser cero, uno y otros estados. Al combinarse los cúbits, el número de estados crece exponencialmente, con lo que la velocidad de las computadoras cuánticas crece a pasos agigantados. Se espera que llegue pronto la “supremacía cuántica”, momento en que la computación cuántica supere a la clásica.

- Por otra parte, la interfaz cerebro-computadora: permite a los usuarios el control de dispositivos externos a partir de señales cerebrales. Aunque está en una fase muy inicial de desarrollo, resulta prometedora.

Oportunidades

Tanto Francisco Cervantes como Omar Montaño destacan las aportaciones que la ia puede hacer en el área médica. Shah (2019) coincide con ellos: señala que para 2030 los médicos tendrán asistentes digitales que escucharán las consultas, tomarán notas sobre el cuidado del paciente, y cuestiones de contabilidad. Gestionarán canalizaciones y arreglarán cuidados preventivos basados en evidencia. Sin embargo, el médico seguirá siendo importante.

Riesgos

Por supuesto, escuchar tantas bondades de la ia nos hace levantar la ceja y preguntarnos por el otro lado de la moneda, ¿cuáles son los riesgos que implica? Turchin (2019) introduce el concepto de ia peligrosa: una ia suficientemente poderosa como para crear riesgos catastróficos: puede o no ser una inteligencia artificial general y quizá no pase la prueba de Turing. Probablemente esté cerca de un nivel humano pero no tenga conciencia. Hay tres formas en que puede volverse peligrosa: podría actuar, de acuerdo con Turchin, en el medio libre como Internet y desempeñarse mejor que un humano en tareas humanas, debido quizá a su habilidad para crear un modelo del mundo y su capacidad para procesar lenguaje natural. La segunda forma es que facilite investigación peligrosa en campos como la biotecnología. La tercera, y que genera mayor preocupación, es si una ia inicia un desarrollo explosivo de inteligencia a través de un proceso de rápido auto-mejoramiento.

Conclusiones

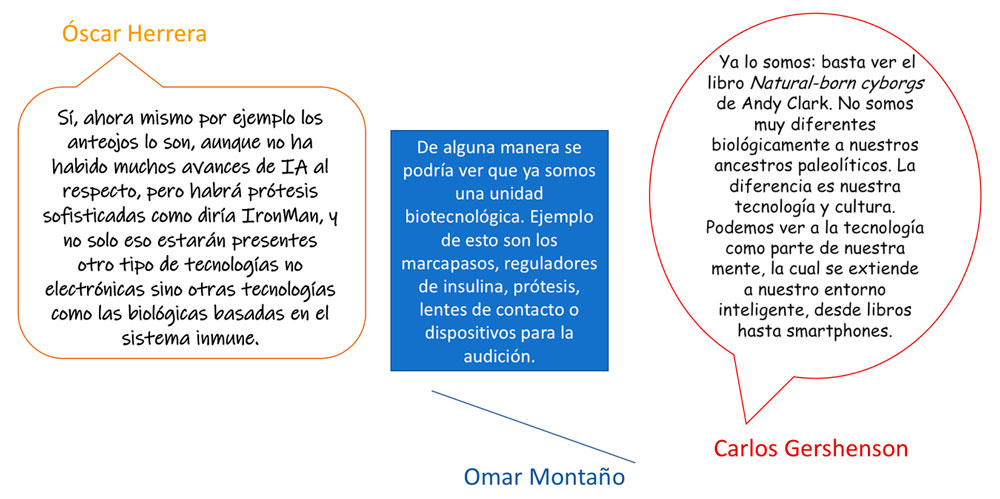

Imagen 3. Opiniones de expertos con respecto a si ya somos o no una unidad biotecnológica.

Sin embargo, Francisco Cervantes señala que “más bien el humano incorporará a su cuerpo cada vez más partes de autómata”. Enfrentamos una gran incertidumbre con relación al futuro de la ia. Podemos estar ciertos de que nos acompañará en diferentes ámbitos de nuestra vida y como todo acompañante, más conviene conocerla con detalle.Referencias

- Braga, A. y Logan, R. K. (2019). Information, 10(2). doi: https://doi.org/10.3390/info10020073.

- Castelfranchi, C. (2013). Alan Turing’s “Computing machinery and intelligence”. Topoi, 32(2), 293–299. doi: https://doi.org/10.1007/s11245-013-9182-y.

- Haenlein, M. y Kaplan, A. (2019). A Brief History of Artificial Intelligence: On the Past, Present, and Future of Artificial Intelligence. Calif. Bus. Rev., 61(4), 5-14. doi: https://doi.org/10.1177/0008125619864925.

- Howard, J. (2019). Artificial intelligence: Implications for the future of work. Am. J. Ind. Med., 62, 917-926. doi: https://doi.org/10.1002/ajim.23037.

- Kaminka, G. A., Sponkoini-Stern, R., Amir, Y., Agmon, N. y Bachelet, I. (2017). Molecular Robots Obeying Asimov’s Three Laws of Robotics. Artif. Life, 23(3), 343-350. doi: https://doi.org/10.1162/ARTL_a_00235.

- Livingston, S. y Risse, M. (2019). The Future Impact of Artificial Intelligence on Humans and Human Rights. Ethics and International Affairs, 33(2), 141-158. doi: https://doi.org/10.1017/s089267941900011x.

- Markoff, J. (1992). Technology: A celebration of Isaac Asimov. The New York Times, 12 de abril. Recuperado de: https://www.nytimes.com/1992/04/12/business/technology-a-celebration-of-isaac-asimov.html?pagewanted=all&src=pm.

- Miller, A. (2019). The intrinsically linked future for human and Artificial Intelligence interaction. J Big Data, 6(38). doi: https://doi.org/10.1186/s40537-019-0202-7.

- Mozilla Foundation. (2019). Preguntamos a distintas personas de todo el mundo qué piensan sobre la inteligencia artificial. Esto es lo que descubrimos. Recuperado de: https://foundation.mozilla.org/es/blog/we-asked-people-around-the-world-how-they-feel-about-artificial-intelligence-heres-what-we-learned/.

- Raul654 (2006). Vernon Vinge en 2006. Recuperada de: https://commons.wikimedia.org/wiki/File:Vernor_Vinge.jpg.

- Shah, N.R. (2019). Health Care in 2030: Will Artificial Intelligence Replace Physicians? Ann Intern Med., 170(6), 407-408. doi: https://doi.org/10.7326/M19-0344.

- Turchin, A. (2019). Assessing the future plausibility of catastrophically dangerous ia. Futures, 107, 45-58. doi: https://doi.org/10.1016/j.futures.2018.11.007.

- Yampolskiy, R. V. (2019). Predicting future ia failures from historic examples. Foresight, 21(1), 138-152. doi: https://doi.org/10.1108/FS-04-2018-0034.

- Zovko, V. (2018). Management in the year 2050. INDECS, 16(3-B), 417-426. doi: https://doi.org/10.7906/indecs.16.3.14.